Naarmate de reikwijdte van kunstmatige intelligentie (AI) en machine learning toeneemt. Het belang van gegevensbescherming in AI-tools wordt steeds groter.

Met de groeiende trend naar AI-personalisatie leggen privacywetten en -regels zoals de General Data Protection Regulation (GDPR) meer nadruk op privatisering en anonimisering van gegevens.

Dit artikel biedt een uitgebreide handleiding om deze sleutelconcepten te begrijpen, hun belang in AI-technologie en hoe je ze effectief kunt implementeren.

Belangrijke concepten begrijpen

Definitie van gegevensprivatisering

Dataprivatisering is een essentieel concept in het huidige digitale tijdperk, omdat het beantwoordt aan de fundamentele behoefte om de persoonlijke en gevoelige informatie van mensen te beschermen.

Naast versleuteling en veilige kunstmatige intelligentie is het een wereldwijde aanpak van gegevensbescherming.

Dit omvat strenge toegangscontroles, robuuste verificatiemechanismen en naleving van de regelgeving voor gegevensverwerking.

Door te benadrukken dat alleen bevoegde entiteiten gegevens kunnen openen, beheren en gebruiken, bevordert gegevensprivatisering het vertrouwen tussen gebruikers en organisaties.

Ervoor zorgen dat er verantwoordelijk en ethisch wordt omgegaan met persoonlijke informatie om de gegevensbeveiliging en privacybescherming voor personen en bedrijven te verbeteren.

Definitie van gegevensanonimisering

Gegevensanonimisering is een cruciale techniek op het gebied van vertrouwelijkheid en beveiliging van gegevens. Het gaat om het transformeren van gegevens op zo'n manier dat het vrijwel onmogelijk is om ze te koppelen aan specifieke individuen, terwijl de bruikbaarheid voor analyse en onderzoek behouden blijft.

Door identificeerbare informatie, zoals namen of sofinummers, te maskeren of te vervangen door pseudoniemen of tokens, stelt anonimisering van gegevens organisaties in staat om waardevolle datasets te delen voor onderzoek, analyse of samenwerking.

Zonder de privacyregels te overtreden of personen bloot te stellen aan potentiële risico's van heridentificatie.

Deze balans tussen het nut van gegevens en de bescherming van privacy is essentieel in de wereld van vandaag, waar verantwoord gegevensbeheer een absolute prioriteit is.

Leer meer over gegevensprivacy in deze video :

Het belang van vertrouwelijkheid van gegevens in AI-tools

Vertrouwelijkheid van gegevens is onmiskenbaar een essentieel aspect van AI en privacybescherming, aangezien AI-tools vaak toegang hebben tot een enorme hoeveelheid persoonlijke gegevens. Deze schat aan informatie maakt gegevensbeveiliging tot een absolute prioriteit.

Vertrouwelijkheid van gegevens garanderen op het gebied van’automatisch leren en AI gaat niet alleen over naleving van de regelgeving; het gaat over het beschermen van gevoelige informatie van mensen.

Een van de grootste zorgen in dit verband is het risico van een datalek. Er is sprake van een inbreuk wanneer onbevoegden toegang krijgen tot gevoelige gegevens en daar misbruik van maken.

Dergelijke incidenten kunnen verstrekkende gevolgen hebben, variërend van financiële verliezen tot reputatieschade en zelfs juridische gevolgen.

Daarom is het essentieel om solide maatregelen te nemen ter bescherming van de vertrouwelijkheid van gegevens om datalekken en de gevolgen daarvan te voorkomen.

Door strikte praktijken op het gebied van vertrouwelijkheid en anonimisering van gegevens te implementeren, kunnen AI-ontwikkelaars de persoonlijke gegevens van gebruikers beschermen tegen ongeautoriseerde toegang en misbruik. Dit schept vertrouwen bij gebruikers en bevordert het gevoel van veiligheid en vertrouwen in de technologie.

Als gebruikers erop kunnen vertrouwen dat hun gegevens veilig zijn, zullen ze eerder geneigd zijn om AI-tools te gebruiken, informatie te delen en opener te interageren, wat leidt tot een vruchtbaardere en harmonieuzere relatie tussen AI en gebruikers.

De rol van gegevensanonimisering in AI-tools

L’Gegevensanonimisering speelt een cruciale rol bij het behoud van privacy, terwijl AI wordt gepersonaliseerd en gegevens op verantwoorde wijze kunnen worden gedeeld en gebruikt.

Door gegevens te anonimiseren kunnen AI-tools de schat aan informatie in Big Data gebruiken zonder de privacy van gebruikers aan te tasten.

Dit is vooral belangrijk bij de verwerking van AI-gegevens, waar een verantwoord gebruik van persoonlijke gegevens de gebruikerservaring aanzienlijk kan verbeteren als het op de juiste manier wordt beheerd.

Hoe privatisering van gegevens te bereiken in gereedschap?

Een stapsgewijze handleiding voor gegevensprivatisering

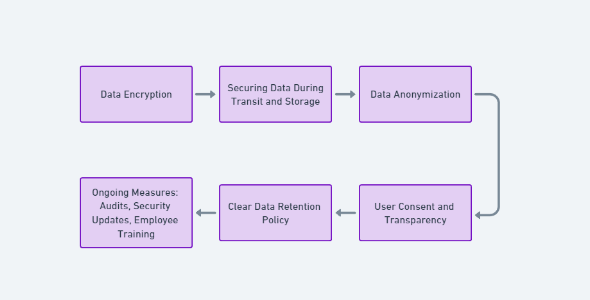

Het privatiseren van gegevens in AI-tools is een veelzijdig proces dat een allesomvattende aanpak vereist. Het begint met het versleutelen van gegevens, het beveiligen van gegevens tijdens het transport en de opslag en het toepassen van toegangscontroles om ervoor te zorgen dat alleen geautoriseerd personeel toegang heeft tot de gegevens.

Deze eerste maatregelen vormen echter slechts de basis van een solide kader voor de bescherming van de privacy.

Anonimisering van gegevens is een cruciaal element, dat de transformatie of verwijdering van persoonlijk identificeerbare informatie (PII) om de privacy van individuen te beschermen en tegelijkertijd de bruikbaarheid van gegevens voor AI-toepassingen te behouden.

Een duidelijk dataretentiebeleid is essentieel om de blootstelling van gegevens te minimaliseren en het risico op datalekken te verkleinen. Dit beleid specificeert hoe lang gegevens worden bewaard en wanneer ze veilig worden verwijderd, zodat je zeker bent van een verantwoord gegevensbeheer.

Toestemming van de gebruiker en transparantie zijn essentiële elementen van gegevensprivatisering. AI-ontwikkelaars moeten geïnformeerde toestemming krijgen gebruikers met betrekking tot het verzamelen en gebruiken van gegevens, waarbij transparant wordt gecommuniceerd over hoe de gegevens worden gebruikt en opgeslagen.

Voortdurende maatregelen omvatten regelmatige audits, beveiligingsupdates en trainingsprogramma's voor werknemers om ons aan te passen aan veranderende bedreigingen, de effectiviteit van maatregelen voor gegevensbescherming te controleren en een cultuur van vertrouwelijkheid van gegevens binnen de organisatie te handhaven.

Deze collectieve inspanningen zijn essentieel voor een robuuste privatisering van gegevens in AI-tools en voor een verantwoorde omgang met gegevens in een wereld die steeds meer door gegevens wordt gedreven.

Beste praktijken in gegevensprivatisering

Het integreren van een “ingebouwde privacy”-benadering in de ontwikkeling van AI-tools betekent een proactieve inzet voor privacybescherming. Deze aanpak vereist dat overwegingen met betrekking tot privacybescherming vanaf het begin op transparante wijze worden geïntegreerd in elke fase van de levenscyclus van het AI-instrument.

Dit omvat niet alleen het initiële ontwerp en de ontwikkeling, maar ook doorlopende monitoring, updates en beoordelingen van potentiële privacyrisico's.

Door privacybescherming in het hart van het AI-ontwerpproces te integreren, kunnen bedrijven de kans op privacyschendingen minimaliseren. En ervoor zorgen dat vertrouwelijkheid van gegevens een fundamenteel principe blijft gedurende de evolutie van de tool.

Daarnaast is transparantie met gebruikers cruciaal om vertrouwen op te bouwen. Bedrijven moeten duidelijk communiceren over hoe gebruikersgegevens worden verzameld, verwerkt en opgeslagen.

Deze transparantie bevordert het gevoel van controle en begrip onder gebruikers, waardoor ze weloverwogen beslissingen kunnen nemen over het delen van hun gegevens.

Open en eerlijke communicatie over datapraktijken bouwt het vertrouwen van gebruikers op en kan uiteindelijk de betrokkenheid en tevredenheid van gebruikers vergroten.

Daarnaast is het essentieel om op de hoogte te blijven van wijzigingen in privacywet- en regelgeving in dit steeds veranderende landschap om aan te passen en te zorgen voor voortdurende naleving, door te laten zien dat ze zich inzetten voor privacynormen en gebruikersrechten.

Gegevensanonimisering implementeren in AI-tools

De’anonimiseringgegevens

Het anonimiseren van gegevens is een proces dat uit meerdere fasen bestaat en ontworpen is om de vertrouwelijkheid van gegevens te garanderen en tegelijkertijd privacyproblemen aan te pakken. In eerste instantie worden gegevens verzameld met toestemming van de gebruiker, in overeenstemming met ethische en wettelijke richtlijnen.

Zodra de gegevens zijn verzameld, wordt identificeerbare informatie, zoals namen en adressen, verwijderd of omgezet met behulp van verschillende anonimiseringstechnieken, zoals gegevensmaskering, pseudonimisering en generalisering.

Deze methoden zijn erop gericht om het moeilijk te maken om specifieke individuen te identificeren op basis van anonieme gegevens, terwijl de bruikbaarheid van de gegevens voor analyse- en onderzoeksdoeleinden behouden blijft.

Tijdens het hele proces staan privacybelangen voorop. Het is essentieel om een evenwicht te vinden tussen nut en privacy. Overmatige anonimisering van gegevens kan ze onbruikbaar maken voor analyse, terwijl onvoldoende anonimisering individuen kan blootstellen aan privacyschendingen en risico's op heridentificatie.

Rigoureus testen van geanonimiseerde gegevens is essentieel om ervoor te zorgen dat zelfs geavanceerde technieken voor het matchen van gegevens de oorspronkelijke gegevens niet opnieuw kunnen identificeren, waardoor een hoog niveau van privacybescherming wordt gehandhaafd.

In het huidige landschap waarin gegevens centraal staan, is verantwoorde anonimisering van gegevens essentieel om de privacy van individuen te beschermen en tegelijkertijd waardevolle informatie uit de verzamelde gegevens te halen.

De beste tools en technieken voor het anonimiseren van gegevens

- Anonimisering van gegevens, zodanig dat KlaverDX, is een fundamentele praktijk op het gebied van vertrouwelijkheid van gegevens en omvat gangbare technieken zoals het maskeren van gegevens, pseudonimiseren en generaliseren.

- Gegevens maskeren, zoals de Delphix maskeren, bestaat uit het vervangen van identificeerbare gegevens door fictieve maar realistische informatie, om de bruikbaarheid van alle gegevens te behouden en tegelijkertijd individuele identiteiten te verbergen.

- Pseudonimisering, zoals die van’Orion, vervangt identificeerbare gegevens door kunstmatige identificatoren of tokens, waardoor gegevens gekoppeld en geanalyseerd kunnen worden zonder persoonlijke gegevens bloot te leggen, wat het aantrekkelijk maakt in de gezondheidszorg en andere contexten.

- Generalisatie, transformeert daarentegen specifieke gegevenskenmerken in bredere categorieën, wat de granulariteit van de gegevens vermindert en het risico op identificatie van individuen minimaliseert.

Deze anonimiseringsmethoden zorgen voor een balans tussen het nut van gegevens en de bescherming van privacy, wat essentieel is voor de ontwikkeling en inzet van AI. Door deze technieken te implementeren, kunnen organisaties de kracht van datagestuurde inzichten benutten en tegelijkertijd gevoelige informatie beschermen en zich houden aan strenge privacyregels.

Op deze manier zorgt het ervoor dat gegevens op verantwoorde wijze worden gedeeld en gebruikt in het steeds veranderende landschap van AI-technologie.

Uitdagingen en oplossingen bij de implementatie van vertrouwelijkheid en anonimisering van gegevens

Uitdagingen

Vertrouwelijkheid en anonimisering van gegevens vormen een aantal uitdagingen, vooral omdat organisaties big data willen exploiteren en tegelijkertijd willen voldoen aan de toenemende regelgeving en het vertrouwen van het publiek willen behouden. publiek.

Een evenwicht vinden tussen het nut van gegevens en de bescherming van de privacy :

- Garandeer dat anonieme gegevens bruikbaar blijven voor analyse terwijl individuele identiteiten effectief worden afgeschermd.

Voldoen aan voortdurend veranderende voorschriften:

- Op de hoogte blijven van privacywet- en regelgeving, zoals de GDPR en de CCPA, en ze naleven.

Risico's in verband met heridentificatie van gegevens :

- Voorkom het risico dat anonieme gegevens kunnen worden herleid naar individuen met behulp van geavanceerde technieken of door het combineren van datasets.

Complexiteit van technieken voor gegevensanonimisering :

- Het implementeren van geavanceerde anonimiseringstechnieken die diepgaande technische expertise vereisen, zoals differentiële vertrouwelijkheid en homomorfe encryptie.

Toewijzing van kosten en middelen :

- Voldoende middelen en budget toewijzen om effectieve programma's voor privacybescherming en gegevensanonimisering te implementeren en te onderhouden.

Publieke perceptie en vertrouwen :

- Het vertrouwen van het publiek opbouwen en behouden door te laten zien dat het zich inzet voor privacybescherming en het ethisch gebruik van gegevens.

Oplossingen

Met het oog op de toenemende regelgeving en het groeiende consumentenbewustzijn moeten bedrijven robuuste oplossingen voor gegevensprivatisering en -anonimisering toepassen. Deze maatregelen beschermen niet alleen gevoelige informatie, maar bevorderen ook het vertrouwen en de naleving.

Differentiële vertrouwelijkheid implementeren :

- Voeg willekeurige ruis toe aan de gegevens of gebruik statistische technieken om ervoor te zorgen dat individuele gegevenspunten niet herleid kunnen worden naar de betreffende individuen, terwijl toch een zinvolle analyse van geaggregeerde gegevens mogelijk blijft.

Gefedereerd leren gebruiken :

- Verwerk gegevens lokaal op de apparaten van gebruikers en deel alleen modelupdates of informatie met de centrale server of cloud, niet de ruwe gegevens zelf. Dit minimaliseert het risico op blootstelling van gegevens en verbetert de vertrouwelijkheid.

Homomorfe encryptie toepassen :

- Versleutel gegevens zodat zodat ze verwerkt of geanalyseerd kunnen worden zonder ontcijferd te worden. Hierdoor kunnen de gegevens volledig veilig in berekeningen worden gebruikt zonder dat de onderliggende informatie wordt blootgelegd.

Afscherming en tokenen van gegevens :

- Vervang gevoelige gegevenselementen door niet-gevoelige equivalenten, bekend als tokens, die kunnen worden teruggebracht tot de oorspronkelijke gegevens met behulp van een veilig tokeningsysteem, of maskeer de gegevens om persoonlijke identificatoren te verbergen.

Gegevensminimalisatie :

- Verzamel alleen gegevens die strikt noodzakelijk zijn voor het beoogde doel en vermijd het opslaan van buitensporige informatie die het risico op een inbreuk op de privacy zou kunnen vergroten. Dit omvat ook het verwijderen van gegevens die niet langer nodig zijn.

Regelmatige privacy-audits en effectbeoordelingen:

- Regelmatig evaluaties uitvoeren om privacyrisico's in verband met gegevensverwerkingsactiviteiten te identificeren en te beperken. Dit omvat het beoordelen van de praktijken voor het verzamelen, opslaan en verwerken van gegevens om ervoor te zorgen dat de wet- en regelgeving op het gebied van privacybescherming wordt nageleefd.

De toekomst van vertrouwelijkheid en anonimisering van gegevens in AI-tools

Naarmate de AI-technologie voortschrijdt, ontwikkelt ook de benadering van vertrouwelijkheid en anonimisering van gegevens zich, met bijzondere aandacht voor de privacy van individuen.

De opkomst van kwantumcomputing belooft onbreekbare encryptie, die de gegevensbescherming zou kunnen versterken en de privacy van individuen in ongekende mate zou kunnen beschermen.

Daarnaast hebben ontwikkelingen in de regelgeving, zoals de Algemene Verordening Gegevensbescherming (RGPD) en zijn wereldwijde equivalenten, blijft het gegevenslandschap in machine learning en AI vormgeven door middel van wetten voor gegevensbescherming.

Deze regels benadrukken het recht van individuen om controle te hebben over hun persoonlijke gegevens en vereisen robuuste beschermingsmaatregelen.

AI-ontwikkelaars en dataspecialisten moeten daarom waakzaam blijven en ervoor zorgen dat hun AI-systemen niet alleen voldoen aan de bestaande regelgeving, maar ook prioriteit geven aan de bescherming van de privacy van individuen gedurende de gehele levenscyclus van gegevens.

In deze dynamische omgeving is het een uitdaging om een delicaat evenwicht te vinden tussen de potentiële voordelen van AI en het behoud van privacyrechten.

Aanpassing en innovatie in het gebruik van gegevens en anonimiseringstechnieken zullen essentieel zijn om te voldoen aan de veranderende eisen van het digitale tijdperk, terwijl de vertrouwelijkheid en veiligheid van individuele gegevens behouden blijft.

Conclusie

La Het implementeren van effectieve privatiserings- en anonimiseringspraktijken in AI-tools is een complexe taak die een grondig begrip vereist van AI-technologie en privacywetgeving.

Met de juiste strategieën en technieken kunnen bedrijven echter een balans vinden tussen de behoefte aan nuttige gegevens en de noodzaak om de privacy van gebruikers te beschermen.

Dit helpt niet alleen om te voldoen aan de regelgeving voor bescherming van privacy, maar ook om vertrouwen op te bouwen bij gebruikers, wat de algehele gebruikerservaring verbetert.

Wil je de juiste AI-oplossing ontwikkelen om je gegevens en de privacy van je klanten te beschermen? Neem contact op met onze experts bij iterates.